Искусственный интеллект – это словосочетание, которое плотно проникло в современный обиход. Сложно найти человека, который не слышал о том, что роботы скоро захватят мир, а также, что если их не остановить, то планете придет конец.

Однако, последние новости, а также действия, которые совершают люди, а не роботы, показывают, что человечество может существовать еще минимум 1 век, потому что находят способы обмана любого робота.

Какая проблема есть у искусственного интеллекта

Самая важная проблема искусственного интеллекта (ИИ) в том, что они четко реагируют на данные. Они чувствительны, а этим пользуются многие хакеры. Действительно, если знать главную слабость роботов, то можно в целом перехитрить систему, а также взломать её.

Общая слабость всей системы ИИ в том, что они не натренированы на то, чтобы осознавать информацию. Они могут принимать только правильные или же неправильные ответы. Таким образом технология машинного обучения сможет четко и правильно отреагировать в той или иной ситуации только тогда, когда у неё уже есть таблица, в которой расписаны многочисленные варианты и примеры решений.

Об этом знают программисты и технологи. Они пытаются придумать современный механизм, который бы смог анализировать проблему самостоятельно, то есть обладать сознанием, которое есть на данный момент у человека.

Пока это не произошло, злоумышленники стараются перехитрить, а также обмануть алгоритм, более подробно об это можно посмотреть в видео

Первые способ обмана: неправильные алгоритмы

Такой способ называют еще poison attack, то есть атака на определённых позициях. Её главная суть заключается в том, что злоумышленники намеренно подсовывают искусственному интеллекту неверные варианты и исходы тех или иных событий. Машина, фильтруя информацию, запоминает неправильную модель поведения.

Если привести пример, то можно представить себе учение, что круг – это на самом деле квадрат. Подсовывая одни данные, но при этом переводя их на совершенно другие, машина буквально путается и ломается.

Если применить такого робота в процессе роботизации, когда даже охранник будет роботом, то при закладывании неправильных данных ИИ может вовсе помогать злоумышленникам проникнуть в банк. Главное – натренировать и заложить ложные данные.

Обратите внимание! Подобные механизмы притормаживают процесс развития ИИ, а также могут губительно повлиять на научное общество.

Второй способ обмана: заставлять ИИ принимать неверные решения

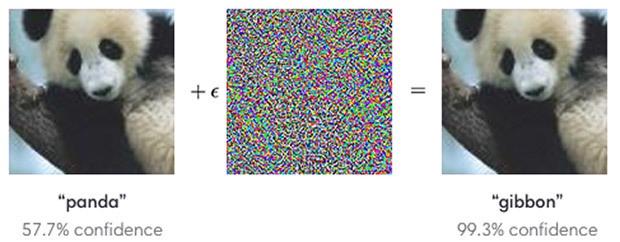

Если знать определённые тонкости в работе с роботами, то можно вывести их из строя простыми приемами. Например, самый популярный процесс, о котором практически все говорят в интернете – робот перепутал изображение.

Человек незаметно подменял изображение, в результате чего панда с вероятностью в 99,3% стала гиббоном. Это показывает то, что искусственный интеллект необходимо изучать и развивать еще больше.

Второй эксперимент провели ученые из университета Карнеги, в котором проводятся подобные экспедиции на разные темы. Суть в том, что ученые выдавали себя за успешных людей, при этом использовали оправу очков, которая была всего лишь заклеена цветной бумагой.

Такому вредоносному воздействию поддаются практически все машины, из-за чего система в целом разрушается. Семантический анализ делает роботов уязвимыми и достаточно слабыми созданиями для подобных технологий.

К чему это все приведет

Злоумышленники, которые перенастраивают роботов, используя их слабые стороны, действительно нарушают безопасность. Роботы необходимы для того, чтобы создавать комфортные условия для существования людей, а не для того, чтобы нарушать его.

Например, ученые из США решили провести эксперимент и замаскировали несколько дорожных знаков ровно таким образом, чтобы ИИ не смог их опознать. Таким образом робот просто сбивался с пути. В будущем это может спроецировать определённые опасные обстоятельства. Это посягает на жизнь мирных людей, не говоря уж об ученых и экспертах.

Почему так происходит

Все достаточно просто. Нейронная сеть может только работать по определённому алгоритму. Когда появляются знаки, которые блокируют привычную для сети ситуацию, то система сбивается с пути. Это можно сравнить с маленьким ребенком, который видит круг, но говорит, что это квадрат.

Искусственный интеллект способен не только сбить те знаки, которые он не понял, но также и поранить бедное животное, которое он воспринял за другого представителя. Если роботы начнут воспринимать более ответственные решения, то никто не может представить, что это породит.

Понять уязвимость машин – это одно дело. Именно этим пользуются различные хакеры и мошенники. Понять причину этих уязвимостей и придумать алгоритм, который будет работать безупречно – та проблема, над которой бьются многие ученые.

Будут ли дальше атаковываться искусственные интеллекты

На самом деле, никто не может это предположить. Ясно одно, что эти машины до сих пор подвержены различным нападениям. Даже традиционная компьютерная система может быть разрушена через интернет при неправильных пользовательских действиях, не говоря уж об интеллекте современности.

Зная, как работает классически антивирус, мошенники продумывают такую систему, которая вовсе блокирует все понимания антивирусного, она его обходит в несколько шагов. Достаточно перешифровать имя, чтобы избавиться от проблемы.

Как защитить ИИ

Если рассматривать самые популярные советы, то можно выдвинуть конкретные рекомендации, которые могут помочь пользователю защитить не только себя, но и ИИ. Это необходимо, так как интеллект призван для того, чтобы защищать человека. К самым популярным советам относят:

- Необходимо использовать только достоверные, а также проверенные источники. Если пользователь не уверен в том, что те данные, которые он получил, действительно безопасны, то такие данные необходимо пересмотреть. Лучше выбрать для обучения более хорошие и качественные источники;

- Стоит проводить качественный анализ. Как только разработчик хочет тестировать свое устройство, необходимо его качественно проанализировать. Сделать это необходимо до тренировки. Также стоит обратиться внимание на то, какие тренировки помогут исключить аномалии;

- Стоит рассмотреть все ситуации, а также их отработать. Чем больше будет отработано ситуаций, тем точнее человек будет уверен в том, что его машина не будет подвержена хакерским нападкам. Это нужно, чтобы повысить точность дальнейшей работы.

Использовать ИИ в сфере безопасности можно и даже необходимо, но делать это нужно осознанно и с максимальной осторожностью, так как все алгоритмы обладают уязвимостью.